转载自黑马程序员的资料

由于每台服务器的运行环境不同,写好的安装流程、部署脚本并不一定在每个服务器都能正常运行。Docker能避免部署对服务器环境的依赖,减少复杂的部署流程,解决程序“在我这可以运行,但是在你那不行”的问题。

快速上手

使用docker部署一个MySQL

1

2

3

4

5

6

|

docker run -d \

--name mysql \

-p 3306:3306 \

-e TZ=Asia/Shanghai \

-e MYSQL_ROOT_PASSWORD=123 \

mysql

|

MySQL安装完毕!通过任意客户端工具即可连接到MySQL.

当执行命令后,Docker做的第一件事情,是去自动搜索并下载了MySQL,然后会自动运行MySQL,完全不用插手,非常方便。

而且,这种安装方式你完全不用考虑运行的操作系统环境,它不仅仅在CentOS系统是这样,在Ubuntu系统、macOS系统、甚至是装了WSL的Windows下,都可以使用这条命令来安装MySQL。

要知道,不同操作系统下其安装包、运行环境是都不相同的!如果是手动安装,必须手动解决安装包不同、环境不同的、配置不同的问题!

而使用Docker,这些完全不用考虑。就是因为Docker会自动搜索并下载MySQL。注意:这里下载的不是安装包,而是镜像。镜像中不仅包含了MySQL本身,还包含了其运行所需要的环境、配置、系统级函数库。因此它在运行时就有自己独立的环境,就可以跨系统运行,也不需要手动再次配置环境了。这套独立运行的隔离环境我们称为容器。

说明:

- 镜像:英文是image

- 容器:英文是container

因此,Docker安装软件的过程,就是自动搜索下载镜像,然后创建并运行容器的过程。

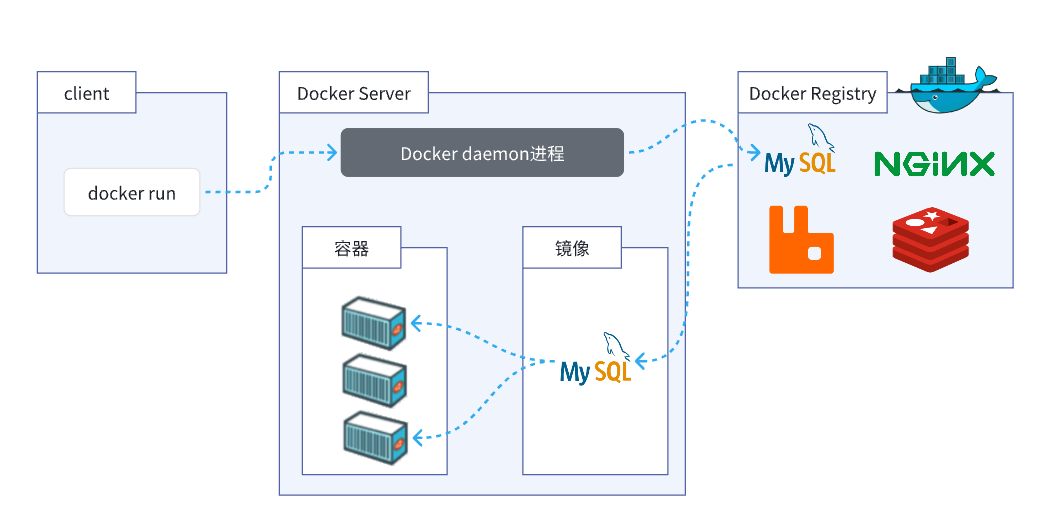

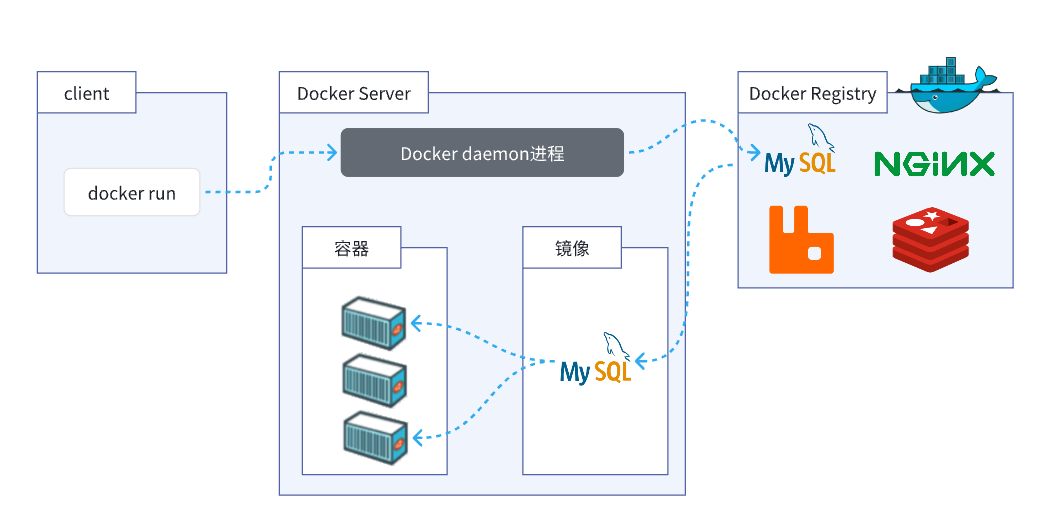

Docker会根据命令中的镜像名称自动搜索并下载镜像,那么问题来了,它是去哪里搜索和下载镜像的呢?这些镜像又是谁制作的呢?

Docker官方提供了一个专门管理、存储镜像的网站,并对外开放了镜像上传、下载的权利。Docker官方提供了一些基础镜像,然后各大软件公司又在基础镜像基础上,制作了自家软件的镜像,全部都存放在这个网站。这个网站就成了Docker镜像交流的社区:

https://hub.docker.com/

基本上我们常用的各种软件都能在这个网站上找到,我们甚至可以自己制作镜像上传上去。

像这种提供存储、管理Docker镜像的服务器,被称为DockerRegistry,可以翻译为镜像仓库。DockerHub网站是官方仓库,阿里云、华为云会提供一些第三方仓库,我们也可以自己搭建私有的镜像仓库。

官方仓库在国外,下载速度较慢,一般我们都会使用第三方仓库提供的镜像加速功能,提高下载速度。而企业内部的机密项目,往往会采用私有镜像仓库。

总之,镜像的来源有两种:

- 基于官方基础镜像自己制作

- 直接去DockerRegistry下载

总结一下:

Docker本身包含一个后台服务,我们可以利用Docker命令告诉Docker服务,帮助我们快速部署指定的应用。Docker服务部署应用时,首先要去搜索并下载应用对应的镜像,然后根据镜像创建并允许容器,应用就部署完成了。

命令解读:

- docker run -d :创建并运行一个容器,-d则是让容器以后台进程运行

- –name mysql : 给容器起个名字叫mysql,你可以叫别的

- -p 3306:3306 : 设置端口映射。

- 容器是隔离环境,外界不可访问。但是可以将宿主机端口映射容器内到端口,当访问宿主机指定端口时,就是在访问容器内的端口了。

- 容器内端口往往是由容器内的进程决定,例如MySQL进程默认端口是3306,因此容器内端口一定是3306;而宿主机端口则可以任意指定,一般与容器内保持一致。

- 格式: -p 宿主机端口:容器内端口,示例中就是将宿主机的3306映射到容器内的3306端口

- -e TZ=Asia/Shanghai : 配置容器内进程运行时的一些参数

- 格式:-e KEY=VALUE,KEY和VALUE都由容器内进程决定

- 案例中,TZ=Asia/Shanghai是设置时区;MYSQL_ROOT_PASSWORD=123是设置MySQL默认密码

- mysql : 设置镜像名称,Docker会根据这个名字搜索并下载镜像

- 格式:REPOSITORY:TAG,例如mysql:8.0,其中REPOSITORY可以理解为镜像名,TAG是版本号

- 在未指定TAG的情况下,默认是最新版本,也就是mysql:latest

镜像的名称不是随意的,而是要到DockerRegistry中寻找,镜像运行时的配置也不是随意的,要参考镜像的帮助文档,这些在DockerHub网站或者软件的官方网站中都能找到。

如果我们要安装其它软件,也可以到DockerRegistry中寻找对应的镜像名称和版本,阅读相关配置即可。

基础命令

Docker官方文档

常见命令

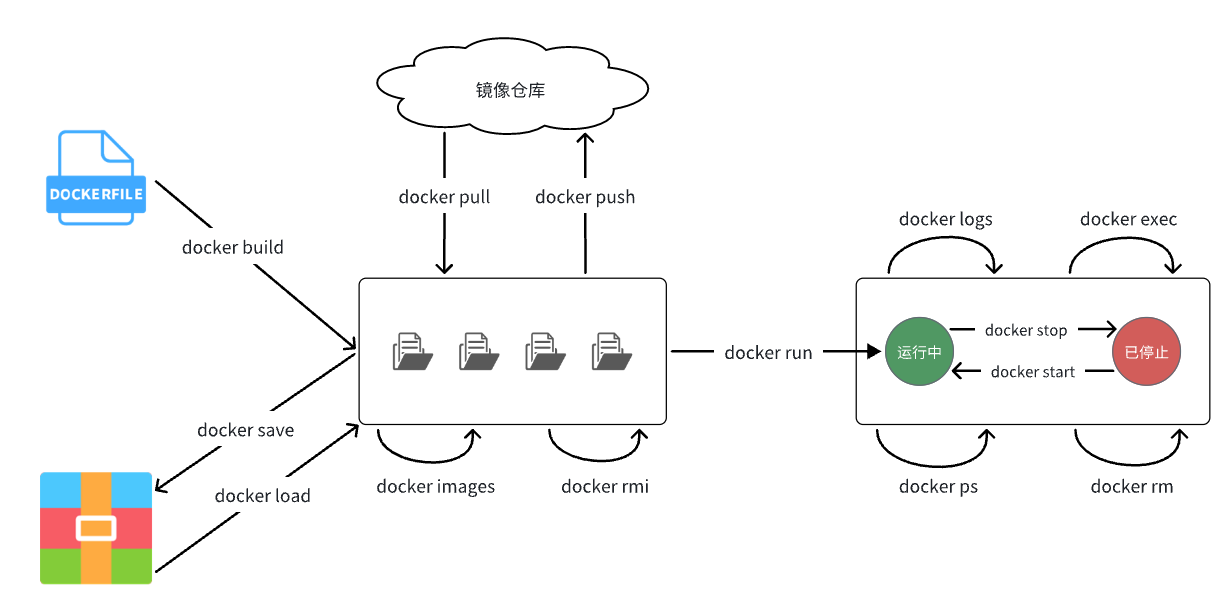

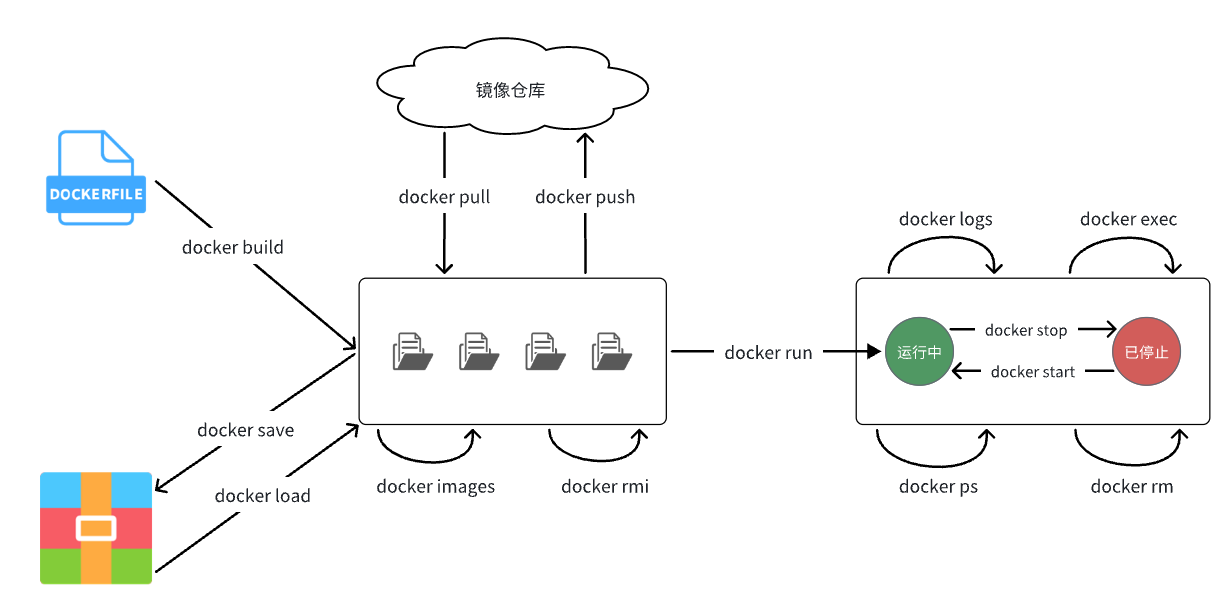

这些命令的关系如下图所示:

默认情况下,每次重启虚拟机我们都需要手动启动Docker和Docker中的容器。通过命令可以实现开机自启:

1

2

3

4

5

|

# Docker开机自启

systemctl enable docker

# Docker容器开机自启

docker update --restart=always [容器名/容器id]

|

以nginx为例演示上面的命令:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

|

# 第1步,去DockerHub查看nginx镜像仓库及相关信息

# 第2步,拉取Nginx镜像

docker pull nginx

# 第3步,查看镜像

docker images

# 结果如下:

REPOSITORY TAG IMAGE ID CREATED SIZE

nginx latest 605c77e624dd 16 months ago 141MB

mysql latest 3218b38490ce 17 months ago 516MB

# 第4步,创建并允许Nginx容器

docker run -d --name nginx -p 80:80 nginx

# 第5步,查看运行中容器

docker ps

# 也可以加格式化方式访问,格式会更加清爽

docker ps --format "table {{.ID}}\t{{.Image}}\t{{.Ports}}\t{{.Status}}\t{{.Names}}"

# 第6步,访问网页,地址:http://虚拟机地址

# 第7步,停止容器

docker stop nginx

# 第8步,查看所有容器

docker ps -a --format "table {{.ID}}\t{{.Image}}\t{{.Ports}}\t{{.Status}}\t{{.Names}}"

# 第9步,再次启动nginx容器

docker start nginx

# 第10步,再次查看容器

docker ps --format "table {{.ID}}\t{{.Image}}\t{{.Ports}}\t{{.Status}}\t{{.Names}}"

# 第11步,查看容器详细信息

docker inspect nginx

# 第12步,进入容器,查看容器内目录

docker exec -it nginx bash

# 或者,可以进入MySQL

docker exec -it mysql mysql -uroot -p

# 第13步,删除容器

docker rm nginx

# 发现无法删除,因为容器运行中,强制删除容器

docker rm -f nginx

|

linux里可以用alias命令给常用Docker命令起别名,方便我们访问:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

|

# 修改/root/.bashrc文件

vi /root/.bashrc

内容如下:

# .bashrc

# User specific aliases and functions

alias rm='rm -i'

alias cp='cp -i'

alias mv='mv -i'

alias dps='docker ps --format "table {{.ID}}\t{{.Image}}\t{{.Ports}}\t{{.Status}}\t{{.Names}}"'

alias dis='docker images'

# Source global definitions

if [ -f /etc/bashrc ]; then

. /etc/bashrc

fi

|

数据卷

容器是隔离环境,容器内程序的文件、配置、运行时产生的容器都在容器内部,要读写容器内的文件非常不方便。下面有几个问题:

- 如果要升级MySQL版本,需要销毁旧容器,那么数据岂不是跟着被销毁了?

- MySQL、Nginx容器运行后,如果我要修改其中的某些配置该怎么办?

- 我想要让Nginx代理我的静态资源怎么办?

因此,容器提供程序的运行环境,但是程序运行产生的数据、程序运行依赖的配置都应该与容器解耦。

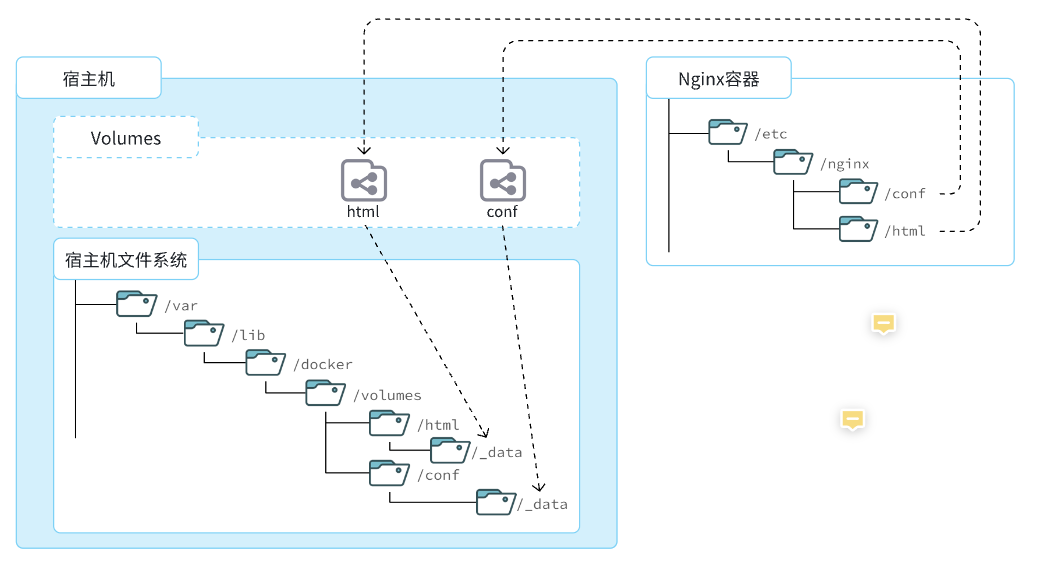

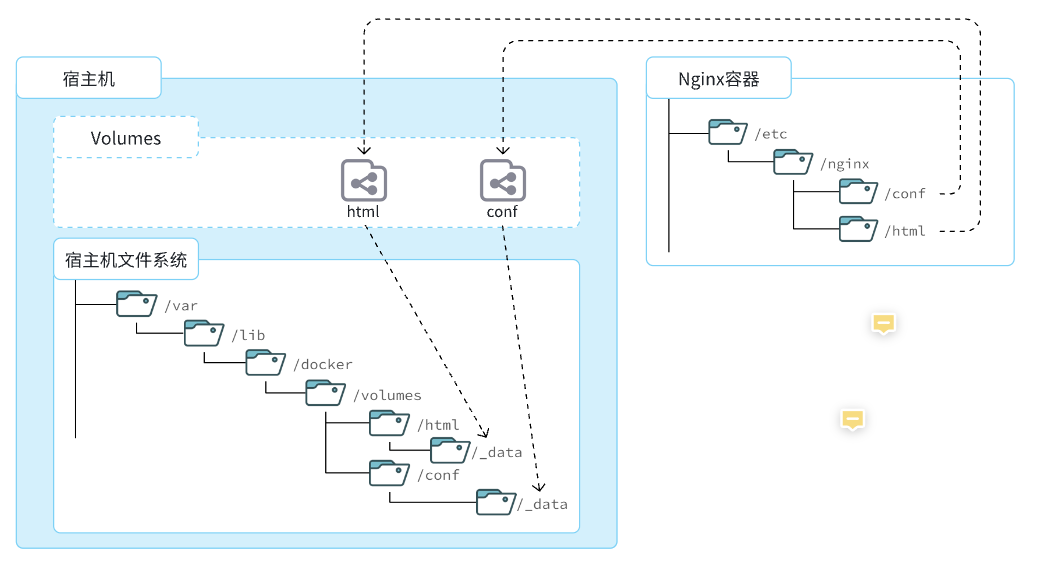

数据卷(volume)是一个虚拟目录,是容器内目录与宿主机目录之间映射的桥梁。

以Nginx为例,我们知道Nginx中有两个关键的目录:

- html:放置一些静态资源

- conf:放置配置文件

如果我们要让Nginx代理我们的静态资源,最好是放到html目录;如果我们要修改Nginx的配置,最好是找到conf下的nginx.conf文件。

但遗憾的是,容器运行的Nginx所有的文件都在容器内部。所以我们必须利用数据卷将两个目录与宿主机目录关联,方便我们操作。如图:

在上图中:

- 我们创建了两个数据卷:conf、html

- Nginx容器内部的conf目录和html目录分别与两个数据卷关联。

- 而数据卷conf和html分别指向了宿主机的

/var/lib/docker/volumes/conf/_data目录和/var/lib/docker/volumes/html/_data目录

这样,容器内的conf和html目录就与宿主机的conf和html目录关联起来,这被称为挂载。此时,我们操作宿主机的/var/lib/docker/volumes/html/_data就是在操作容器内的/usr/share/nginx/html/_data目录。只要我们将静态资源放入宿主机对应目录,就可以被Nginx代理了

小提示:

/var/lib/docker/volumes这个目录就是默认的存放所有容器数据卷的目录,其下再根据数据卷名称创建新目录,格式为/数据卷名/_data。

为什么不让容器目录直接指向宿主机目录呢?

- 因为直接指向宿主机目录就与宿主机强耦合了,如果切换了环境,宿主机目录就可能发生改变了。由于容器一旦创建,目录挂载就无法修改,这样容器就无法正常工作了。

- 但是容器指向数据卷,一个逻辑名称,而数据卷再指向宿主机目录,就不存在强耦合。如果宿主机目录发生改变,只要改变数据卷与宿主机目录之间的映射关系即可。

不过,我们通过由于数据卷目录比较深,不好寻找,通常我们也允许让容器直接与宿主机目录挂载而不使用数据卷,具体参考后文。

数据卷常用命令:

注意:容器与数据卷的挂载要在创建容器时配置,对于创建好的容器,是不能设置数据卷的。而且创建容器的过程中,数据卷会自动创建。

教学演示环节:演示一下nginx的html目录挂载。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

|

# 1.首先创建容器并指定数据卷,注意通过 -v 参数来指定数据卷

docker run -d --name nginx -p 80:80 -v html:/usr/share/nginx/html nginx

# 2.然后查看数据卷

docker volume ls

# 结果

DRIVER VOLUME NAME

local 29524ff09715d3688eae3f99803a2796558dbd00ca584a25a4bbc193ca82459f

local html

# 3.查看数据卷详情

docker volume inspect html

# 结果

[

{

"CreatedAt": "2024-05-17T19:57:08+08:00",

"Driver": "local",

"Labels": null,

"Mountpoint": "/var/lib/docker/volumes/html/_data",

"Name": "html",

"Options": null,

"Scope": "local"

}

]

# 4.查看/var/lib/docker/volumes/html/_data目录

ll /var/lib/docker/volumes/html/_data

# 可以看到与nginx的html目录内容一样,结果如下:

总用量 8

-rw-r--r--. 1 root root 497 12月 28 2021 50x.html

-rw-r--r--. 1 root root 615 12月 28 2021 index.html

# 5.进入该目录,并随意修改index.html内容

cd /var/lib/docker/volumes/html/_data

vi index.html

# 6.打开页面,查看效果

# 7.进入容器内部,查看/usr/share/nginx/html目录内的文件是否变化

docker exec -it nginx bash

|

教学演示环节:演示一下MySQL的匿名数据卷

1

2

3

|

# 查看MySQL容器详细信息

docker inspect mysql

# 关注其中.Config.Volumes部分和.Mounts部分

|

可以发现.Config.Volumes里这个容器声明了一个本地目录,需要挂载数据卷,但是数据卷未定义。这就是匿名卷。

1

2

3

4

5

6

7

8

9

|

{

"Config": {

// ... 略

"Volumes": {

"/var/lib/mysql": {}

}

// ... 略

}

}

|

然后,再看结果中的.Mounts部分

1

2

3

4

5

6

7

8

9

10

11

|

{

"Mounts": [

{

"Type": "volume",

"Name": "29524ff09715d3688eae3f99803a2796558dbd00ca584a25a4bbc193ca82459f",

"Source": "/var/lib/docker/volumes/29524ff09715d3688eae3f99803a2796558dbd00ca584a25a4bbc193ca82459f/_data",

"Destination": "/var/lib/mysql",

"Driver": "local",

}

]

}

|

可以发现,其中有几个关键属性:

- Name:数据卷名称。由于定义容器未设置容器名,这里的就是匿名卷自动生成的名字,一串hash值。

- Source:宿主机目录

- Destination : 容器内的目录

上述配置是将容器内的/var/lib/mysql这个目录,与数据卷29524ff09715d3688eae3f99803a2796558dbd00ca584a25a4bbc193ca82459f挂载。于是在宿主机中就有了/var/lib/docker/volumes/29524ff09715d3688eae3f99803a2796558dbd00ca584a25a4bbc193ca82459f/_data这个目录。这就是匿名数据卷对应的目录,其使用方式与普通数据卷没有差别。

接下来,可以查看该目录下的MySQL的data文件:

ls -l /var/lib/docker/volumes/29524ff09715d3688eae3f99803a2796558dbd00ca584a25a4bbc193ca82459f/_data

注意:每一个不同的镜像,将来创建容器后内部有哪些目录可以挂载,可以参考DockerHub对应的页面

可以发现,数据卷的目录结构较深,如果我们去操作数据卷目录会不太方便。在很多情况下,我们会直接将容器目录与宿主机指定目录挂载。挂载语法与数据卷类似:

1

2

3

4

|

# 挂载本地目录

-v 本地目录:容器内目录

# 挂载本地文件

-v 本地文件:容器内文件

|

注意:本地目录或文件必须以 / 或 ./开头,如果直接以名字开头,会被识别为数据卷名而非本地目录名。

例如:

1

2

|

-v mysql:/var/lib/mysql # 会被识别为一个数据卷叫mysql,运行时会自动创建这个数据卷

-v ./mysql:/var/lib/mysql # 会被识别为当前目录下的mysql目录,运行时如果不存在会创建目录

|

镜像

前面我们一直在使用别人准备好的镜像,那如果我要部署一个Java项目,把它打包为一个镜像该怎么做呢?

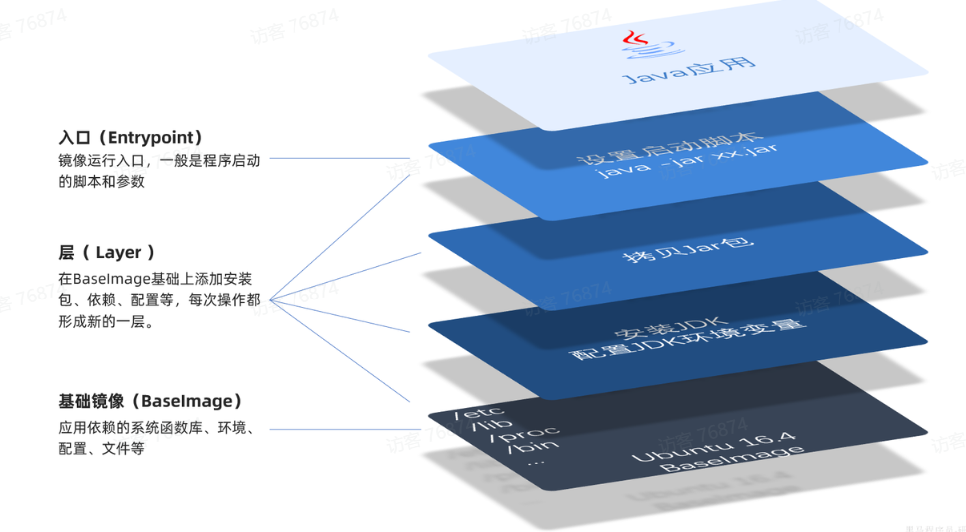

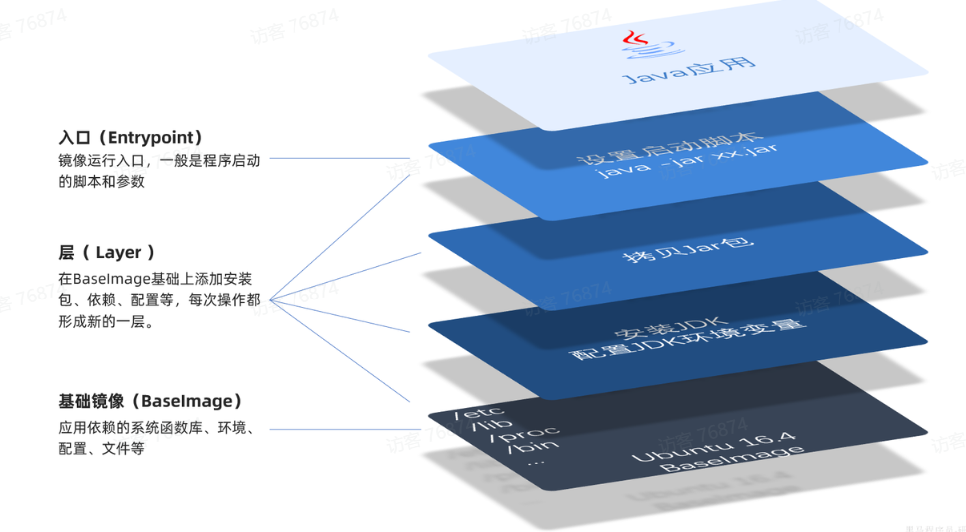

要想自己构建镜像,必须先了解镜像的结构。

镜像之所以能让我们快速跨操作系统部署应用而忽略其运行环境、配置,就是因为镜像中包含了程序运行需要的系统函数库、环境、配置、依赖。

因此,自定义镜像本质就是依次准备好程序运行的基础环境、依赖、应用本身、运行配置等文件,并且打包而成。

举个例子,我们要从0部署一个Java应用,大概流程是这样:

- 准备一个linux服务(CentOS或者Ubuntu均可)

- 安装并配置JDK

- 上传Jar包

- 运行jar包

那因此,我们打包镜像也是分成这么几步:

- 准备Linux运行环境(java项目并不需要完整的操作系统,仅仅是基础运行环境即可)

- 安装并配置JDK

- 拷贝jar包

- 配置启动脚本

上述步骤中的每一次操作其实都是在生产一些文件(系统运行环境、函数库、配置最终都是磁盘文件),所以镜像就是一堆文件的集合。

但需要注意的是,镜像文件不是随意堆放的,而是按照操作的步骤分层叠加而成,每一层形成的文件都会单独打包并标记一个唯一id,称为Layer(层)。这样,如果我们构建时用到的某些层其他人已经制作过,就可以直接拷贝使用这些层,而不用重复制作。

例如,第一步中需要的Linux运行环境,通用性就很强,所以Docker官方就制作了这样的只包含Linux运行环境的镜像。我们在制作java镜像时,就无需重复制作,直接使用Docker官方提供的CentOS或Ubuntu镜像作为基础镜像。然后再搭建其它层即可,这样逐层搭建,最终整个Java项目的镜像结构如图所示:

由于制作镜像的过程中,需要逐层处理和打包,比较复杂,所以Docker就提供了自动打包镜像的功能。我们只需要将打包的过程,每一层要做的事情用固定的语法写下来,交给Docker去执行即可。

而这种记录镜像结构的文件就称为Dockerfile,其对应的语法可以参考官方文档

| 指令 |

说明 |

示例 |

| FROM |

指定基础镜像 |

FROM python:3.11-slim |

| ENV |

设置环境变量,可在后面指令使用 |

ENV TZ=Asia/Shanghai |

| COPY |

拷贝本地文件到镜像的指定目录 |

COPY requirements.txt . |

| RUN |

执行Linux的shell命令,一般是安装过程的命令 |

RUN pip install –no-cache-dir -r requirements.txt |

| EXPOSE |

指定容器运行时监听的端口,是给镜像使用者看的 |

EXPOSE 8080 |

| ENTRYPOINT |

镜像中应用的启动命令,容器运行时调用 |

ENTRYPOINT java -jar xx.jar |

这里修改了示例项目,使用能直接上手的python项目,而不是黑马教程里用的黑马商城项目。

例如,要基于Ubuntu镜像来构建一个Python应用,项目结构:

1

2

3

4

5

6

7

|

rust@bird:~/docker-demo$ ll

总计 20

drwxrwxr-x 2 rust rust 4096 4月 11 14:24 ./

drwxr-xr-x 24 rust rust 4096 4月 11 14:24 ../

-rw-rw-r-- 1 rust rust 246 4月 11 14:14 app.py

-rw-rw-r-- 1 rust rust 463 4月 11 14:24 dockerfile

-rw-rw-r-- 1 rust rust 7 4月 11 14:13 requirements.txt

|

requirements.txt里填入flask,app.py内容如下:

1

2

3

4

5

6

7

8

9

10

11

|

from flask import Flask

import os

app = Flask(__name__)

@app.route("/")

def hello():

return f"Hello from Docker! Python works. Hostname={os.uname().nodename}\n"

if __name__ == "__main__":

app.run(host="0.0.0.0", port=8000)

|

其Dockerfile内容如下:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

|

# 指定基础镜像(这里没有从Linux镜像开始)

FROM python:3.11-slim

# 时区

ENV TZ=Asia/Shanghai

RUN ln -snf /usr/share/zoneinfo/$TZ /etc/localtime && echo $TZ > /etc/timezone

# 设置工作目录

WORKDIR /app

# 先拷贝依赖清单,利用 Docker 分层缓存

COPY requirements.txt .

RUN pip install --no-cache-dir -r requirements.txt

# 再拷贝代码

COPY app.py .

# 声明监听端口

EXPOSE 8000

# 入口命令

CMD ["python", "app.py"]

|

学习工作中会有很多Python项目需要打包为镜像,他们都需要Linux系统环境、Python环境这两层,只有上面的3层不同(因为项目代码不同)。如果每次制作Python镜像都重复制作前两层镜像,会很麻烦。

所以,就有人提供了基础的系统加Python环境,我们在此基础上制作Python镜像,就可以省去Python的配置了:

准备好python代码、依赖文件和dockerfile之后,就可以利用命令来构建镜像了

1

2

3

4

|

# 进入镜像目录

cd ~/docker-demo

# 开始构建

docker build -t docker-demo:1.0 .

|

命令说明:

- docker build : 就是构建一个docker镜像

- -t docker-demo:1.0 :-t参数是指定镜像的名称(repository和tag)

- . : 最后的点是指构建时Dockerfile所在路径,.代表当前目录,也可以直接指定Dockerfile目录:

docker build -t docker-demo:1.0 ~/docker-demo

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

|

rust@bird:~/docker-demo$ docker build -t docker-demo:1.0 .

[+] Building 100.4s (11/11) FINISHED docker:default

=> [internal] load build definition from dockerfile 0.0s

=> => transferring dockerfile: 502B 0.0s

=> [internal] load metadata for docker.io/library/python:3.11-slim 52.3s

=> [internal] load .dockerignore 0.0s

=> => transferring context: 2B 0.0s

=> [1/6] FROM docker.io/library/python:3.11-slim@sha256:233de06753d30d120b1a3ce359d8d3be8bda78524cd8f5 32.6s

=> => resolve docker.io/library/python:3.11-slim@sha256:233de06753d30d120b1a3ce359d8d3be8bda78524cd8f52 0.0s

=> => sha256:5435b2dcdf5cb7faa0d5b1d4d54be2c72a776fab9a605336f5067d6e9ecb5976 29.78MB / 29.78MB 18.3s

=> => sha256:37ffa6577b04e98598e2c10432eb8c66cfc1af6c7698b21c6163f8334606aa14 1.29MB / 1.29MB 18.0s

=> => sha256:d98f36ba21593a4014243f41ec9c5370abd34f4f65a5d074e41bce23f5f6a165 14.37MB / 14.37MB 23.9s

=> => sha256:233de06753d30d120b1a3ce359d8d3be8bda78524cd8f520c99883bfe33964cf 10.37kB / 10.37kB 0.0s

=> => sha256:ad65166ad2583036804a3f772ec8f1cad733cf77d631c6840ab1ea9231b6b350 1.75kB / 1.75kB 0.0s

=> => sha256:d1a45c0fb43d72e0c013ee97d460aa8f49f2c1bbd588b17a558cc6f7078b4276 5.48kB / 5.48kB 0.0s

=> => sha256:0816ee351b60c03c7a77a3f50c717891eedd927f4e6a1d59f6cce05268065606 251B / 251B 32.6s

=> => extracting sha256:5435b2dcdf5cb7faa0d5b1d4d54be2c72a776fab9a605336f5067d6e9ecb5976 1.0s

=> => extracting sha256:37ffa6577b04e98598e2c10432eb8c66cfc1af6c7698b21c6163f8334606aa14 0.1s

=> => extracting sha256:d98f36ba21593a4014243f41ec9c5370abd34f4f65a5d074e41bce23f5f6a165 0.7s

=> => extracting sha256:0816ee351b60c03c7a77a3f50c717891eedd927f4e6a1d59f6cce05268065606 0.0s

=> [internal] load build context 0.0s

=> => transferring context: 333B 0.0s

=> [2/6] RUN ln -snf /usr/share/zoneinfo/Asia/Shanghai /etc/localtime && echo Asia/Shanghai > /etc/time 0.7s

=> [3/6] WORKDIR /app 0.0s

=> [4/6] COPY requirements.txt . 0.0s

=> [5/6] RUN pip install --no-cache-dir -r requirements.txt 14.5s

=> [6/6] COPY app.py . 0.0s

=> exporting to image 0.1s

=> => exporting layers 0.1s

=> => writing image sha256:da9e550b6449667879ae1a72189501bb49522ccc2aa21c34108fdeb89b4bb976 0.0s

=> => naming to docker.io/library/docker-demo:1.0

|

查看镜像列表:

1

2

3

4

5

6

7

8

|

# 查看镜像列表:

docker images

# 结果

rust@bird:~/docker-demo$ docker images

REPOSITORY TAG IMAGE ID CREATED SIZE

docker-demo 1.0 da9e550b6449 4 minutes ago 140MB

mysql 8.0.32 412b8cc72e4a 3 years ago 531MB

nginx latest 3f8a4339aadd 8 years ago 108MB

|

尝试运行镜像:

1

2

3

4

5

6

7

8

9

10

11

12

13

|

# 1.创建并运行容器

docker run -d --name pyweb2 -p 8000:8000 -e TZ=Asia/Shanghai docker-demo:1.0

# 2.查看容器

rust@bird:~/docker-demo$ docker ps

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

d8e3a9172300 docker-demo:1.0 "python app.py" 3 seconds ago Up 3 seconds 0.0.0.0:8000->8000/tcp, :::8000->8000/tcp pyweb2

0de3d38b0e0f mysql:8.0.32 "docker-entrypoint.s…" 42 minutes ago Up 42 minutes 0.0.0.0:3306->3306/tcp, :::3306->3306/tcp, 33060/tcp mysql

# 3.访问

curl http://localhost:8000/

# 结果

rust@bird:~/docker-demo$ curl http://localhost:8000/

Hello from Docker! Python works. Hostname=d8e3a9172300

|

网络

创建容器后,容器之间能否互相访问呢?(Python项目往往需要访问其它各种中间件,例如MySQL、Redis等)

查看下MySQL容器的详细信息,重点关注其中的网络IP地址:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

|

# 1.用基本命令,寻找Networks.bridge.IPAddress属性

docker inspect mysql

# 也可以使用format过滤结果

docker inspect --format='{{range .NetworkSettings.Networks}}{{println .IPAddress}}{{end}}' mysql

# 得到IP地址如下:

172.19.0.2

# 2.然后通过命令进入dd容器

docker exec -it pyweb2 bash

# 3.在容器内,通过ping命令测试网络

apt-get update

apt-get install -y iputils-ping

ping 172.19.0.2

# 结果

PING 172.19.0.2 (172.19.0.2) 56(84) bytes of data.

64 bytes from 172.19.0.2: icmp_seq=1 ttl=64 time=0.053 ms

64 bytes from 172.19.0.2: icmp_seq=2 ttl=64 time=0.059 ms

64 bytes from 172.19.0.2: icmp_seq=3 ttl=64 time=0.058 ms

|

发现可以互联,没有问题。

但是,容器的网络IP其实是一个虚拟的IP,其值并不固定与某一个容器绑定,如果我们在开发时写死某个IP,而在部署时很可能MySQL容器的IP会发生变化,连接会失败。

所以,必须借助于docker的网络功能来解决这个问题,官方文档

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

|

# 1.首先通过命令创建一个网络

docker network create demo-net

# 2.然后查看网络

docker network ls

# 结果:

rust@bird:~/docker-demo$ docker network ls

NETWORK ID NAME DRIVER SCOPE

3d0ccb61692f bridge bridge local

bb2fa2b35127 demo-net bridge local

89a54c5d5b83 host host local

23a70f2198b6 none null local

# 其中,除了demo-net以外,其它都是默认的网络

# 3.让pyweb2和mysql都加入该网络,注意,在加入网络时可以通过--alias给容器起别名

# 这样该网络内的其它容器可以用别名互相访问!

# 3.1.mysql容器,指定别名为db,另外每一个容器都有一个别名是容器名

docker network connect demo-net mysql --alias db

# 3.2.db容器,也就是我们的python项目

docker network connect demo-net pyweb2

# 4.进入pyweb2容器,尝试利用别名访问db

# 4.1.进入容器

docker exec -it pyweb2 bash

# 4.2.用db别名访问

ping db

# 结果

root@d8e3a9172300:/app# ping db

PING db (172.19.0.2) 56(84) bytes of data.

64 bytes from mysql.demo-net (172.19.0.2): icmp_seq=1 ttl=64 time=0.079 ms

64 bytes from mysql.demo-net (172.19.0.2): icmp_seq=2 ttl=64 time=0.044 ms

64 bytes from mysql.demo-net (172.19.0.2): icmp_seq=3 ttl=64 time=0.067 ms

64 bytes from mysql.demo-net (172.19.0.2): icmp_seq=4 ttl=64 time=0.058 ms

# 4.3.用容器名访问

ping mysql

# 结果:

root@d8e3a9172300:/app# ping mysql

PING mysql (172.19.0.2) 56(84) bytes of data.

64 bytes from mysql.demo-net (172.19.0.2): icmp_seq=1 ttl=64 time=0.036 ms

64 bytes from mysql.demo-net (172.19.0.2): icmp_seq=2 ttl=64 time=0.055 ms

64 bytes from mysql.demo-net (172.19.0.2): icmp_seq=3 ttl=64 time=0.054 ms

64 bytes from mysql.demo-net (172.19.0.2): icmp_seq=4 ttl=64 time=0.064 ms

|

总结:

- 在自定义网络中,可以给容器起多个别名,默认的别名是容器名本身

- 在同一个自定义网络中的容器,可以通过别名互相访问

DockerCompose

部署一个简单的java项目,其中包含3个容器:

- MySQL(命名卷持久化数据);

- Python Flask 应用(连接 MySQL,启动后自动建表、写入示例数据并对外暴露 HTTP 接口)。

而稍微复杂的项目,其中还会有各种各样的其它中间件,需要部署的东西远不止3个。如果还像之前那样手动的逐一部署,就太麻烦了。

而Docker Compose就可以实现多个相互关联的Docker容器的快速部署。它允许用户通过一个单独的 docker-compose.yml 模板文件(YAML 格式)来定义一组相关联的应用容器。

docker-compose.yml文件的基本语法可以参考官方文档

项目准备

目录结构

1

2

3

4

5

6

7

8

9

10

11

|

~/docker-demo/compose/

app/

app.py

requirements.txt

Dockerfile

docker-compose.yml

mysql/

init/

01-init.sql

conf/

(可选自定义配置)

|

requirements.txt填入:

dockerfile填入:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

|

FROM python:3.11-slim

ENV TZ=Asia/Shanghai

RUN ln -snf /usr/share/zoneinfo/$TZ /etc/localtime && echo $TZ > /etc/timezone

WORKDIR /app

COPY requirements.txt .

RUN pip install --no-cache-dir -r requirements.txt

COPY app.py .

EXPOSE 8008

CMD ["python", "app.py"]

|

app.py连接 MySQL 并对外提供接口,内容如下:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

|

from flask import Flask, jsonify

import os

import pymysql

app = Flask(__name__)

def get_conn():

return MySQLdb.connect(

host=os.getenv("DB_HOST", "mysql"),

port=int(os.getenv("DB_PORT", "3306")),

user=os.getenv("DB_USER", "root"),

passwd=os.getenv("DB_PASSWORD", "123456"),

db=os.getenv("DB_NAME", "demo"),

charset="utf8mb4"

)

@app.route("/api/health")

def health():

return jsonify({"status": "ok", "service": "python"})

@app.route("/api/db")

def db_test():

conn = get_conn()

cur = conn.cursor()

cur.execute("SELECT VERSION()")

row = cur.fetchone()

cur.close()

conn.close()

return jsonify({"mysql_version": row[0] if row else None})

@app.route("/api/users")

def users():

conn = get_conn()

cur = conn.cursor()

cur.execute("CREATE TABLE IF NOT EXISTS users (id INT AUTO_INCREMENT PRIMARY KEY, name VARCHAR(255));")

cur.execute("INSERT INTO users (name) VALUES ('Alice'),('Bob');")

conn.commit()

cur.execute("SELECT id, name FROM users;")

rows = cur.fetchall()

cur.close()

conn.close()

return jsonify([{"id": r[0], "name": r[1]} for r in rows])

if __name__ == "__main__":

app.run(host="0.0.0.0", port=8000)

|

mysql/init/01-init.sql(初始化脚本,可选),填入CREATE DATABASE IF NOT EXISTS demo CHARACTER SET utf8mb4 COLLATE utf8mb4_general_ci;

docker-compose.yml准备

docker-compose.yml内容如下:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

|

services:

mysql:

image: mysql:8.0.32

container_name: mysql

restart: always

ports:

- "3306:3306"

environment:

TZ: Asia/Shanghai

MYSQL_ROOT_PASSWORD: "123456"

MYSQL_DATABASE: "demo"

volumes:

- ./mysql/init:/docker-entrypoint-initdb.d # 初始化 SQL

- mysql-data:/var/lib/mysql # 持久化数据

networks:

- demo-net

python:

build: ./app # 使用上面的 Dockerfile 构建

container_name: python

restart: always

ports:

- "8008:8000" # 之前的pyweb2练习占用了虚拟机的8000端口,映射到虚拟机的8008端口

environment:

TZ: Asia/Shanghai

DB_HOST: "mysql" # 在同一网络中用服务名访问

DB_PORT: "3306"

DB_USER: "root"

DB_PASSWORD: "123456"

DB_NAME: "demo"

depends_on:

- mysql # 确保 MySQL 先启动

networks:

- demo-net

volumes:

mysql-data:

networks:

demo-net:

name: demo-net

external: true # 声明:这是外部网络,Compose 不会自己去建(复用前面建的网络)

|

启动与验证

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

|

cd ~/docker-demo/compose

# 清理残留的mysql

docker container stop mysql

docker container rm mysql

# 启动所有服务

docker compose up -d

# 查看容器状态

docker compose ps

# 查看日志

docker compose logs -f python

docker compose logs -f mysql

# 访问 Python 接口

curl http://localhost:8008/api/health

curl http://localhost:8008/api/db

curl http://localhost:8008/api/users

# 进入 Python 容器查看网络

docker compose exec python bash

# 在容器内

apt-get update

apt-get install -y iputils-ping

ping mysql

|

停止与清理

1

2

3

4

5

6

7

8

9

10

11

12

13

14

|

# 停止并移除容器/网络(保留卷)

docker compose down

# 停止并移除容器、网络、卷(清空数据)

docker compose down -v

# 清理之前的练习

docker container stop pyweb2

docker container stop mysql

docker container rm pyweb2

docker container rm mysql

docker network rm demo-net

|

docker-compose参数介绍

docker-compose文件中可以定义多个相互关联的应用容器,每一个应用容器被称为一个服务(service)。由于service就是在定义某个应用的运行时参数,因此与docker run参数非常相似。

举例来说,用docker run部署MySQL的命令如下:

1

2

3

4

5

6

7

8

9

10

|

docker run -d \

--name mysql \

-p 3306:3306 \

-e TZ=Asia/Shanghai \

-e MYSQL_ROOT_PASSWORD=123456 \

-v ./mysql/data:/var/lib/mysql \

-v ./mysql/conf:/etc/mysql/conf.d \

-v ./mysql/init:/docker-entrypoint-initdb.d \

--network demo-net

mysql

|

如果用docker-compose.yml文件来定义,就是这样:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

|

version: "3.8"

services:

mysql:

image: mysql

container_name: mysql

ports:

- "3306:3306"

environment:

TZ: Asia/Shanghai

MYSQL_ROOT_PASSWORD: 123456

volumes:

- "./mysql/conf:/etc/mysql/conf.d"

- "./mysql/data:/var/lib/mysql"

networks:

- new

networks:

new:

name: demo-net

|

对比如下:

| docker run 参数 |

docker compose 指令 |

说明 |

| –name |

container_name |

容器名称 |

| -p |

ports |

端口映射 |

| -e |

environment |

环境变量 |

| -v |

volumes |

数据卷配置 |

| –network |

networks |

网络 |

编写好docker-compose.yml文件,就可以部署项目了。常见的命令

docker compose [OPTIONS] [COMMAND]

其中,OPTIONS和COMMAND都是可选参数,比较常见的有:

| 类型 |

参数或指令 |

说明 |

| Options |

-f |

指定compose文件的路径和名称 |

| -p |

指定project名称。project就是当前compose文件中设置的多个service的集合,是逻辑概念 |

| Commands |

up |

创建并启动所有service容器 |

| down |

停止并移除所有容器、网络 |

| ps |

列出所有启动的容器 |

| logs |

查看指定容器的日志 |

| stop |

停止容器 |

| start |

启动容器 |

| restart |

重启容器 |

| top |

查看运行的进程 |

| exec |

在指定的运行中容器中执行命令 |